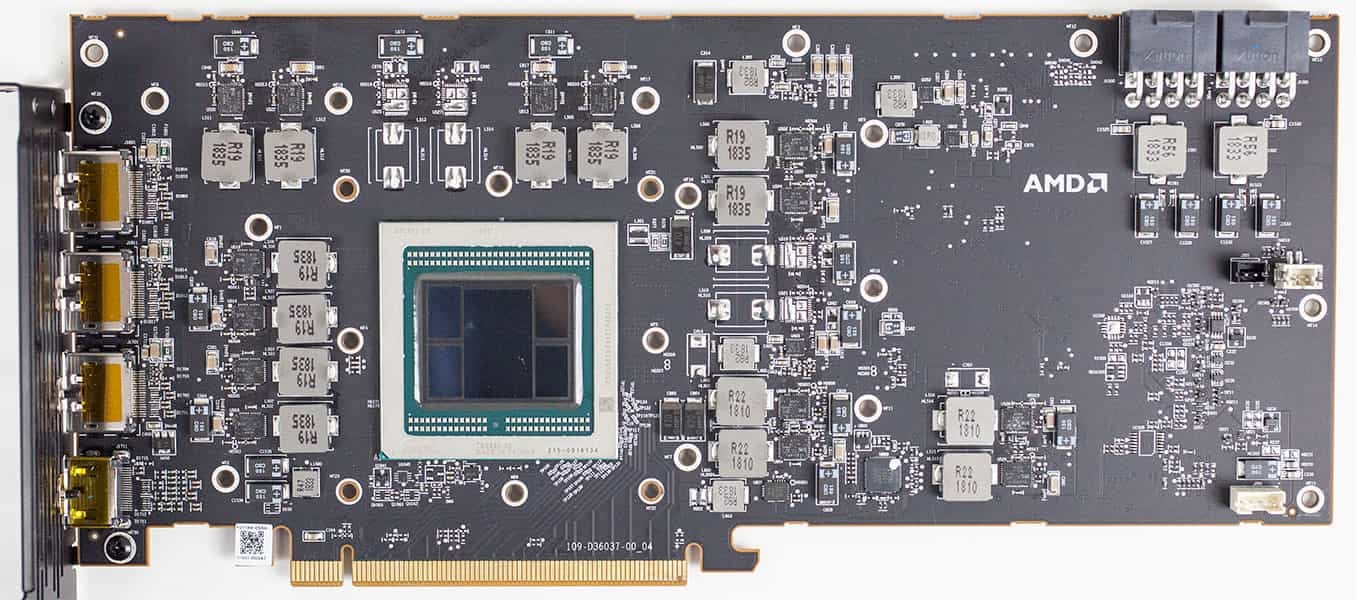

Tento týden (mělo by to být 7. února) by se měl začít prodávat Radeon VII, tedy highendová herní grafika AMD s čipem Vega 20, zatím prvním 7nm GPU. Recenze patrně vyjdou současně s tím, ale už teď o pár dní dřív AMD patrně povolilo NDA a dovolilo novinářům publikovat fotografie karet. Na webu se tak objevily obrázky reálného provedení (zatím jsme totiž měli hlavně vizualizace nebo málo ostré fotky z CES) a co je asi zajímavější – rozborky ukazující, co čeká uvnitř.

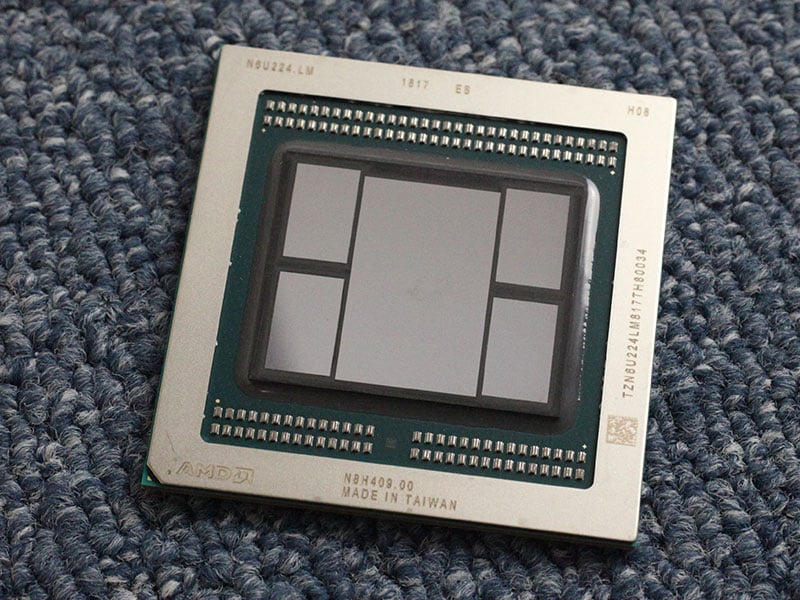

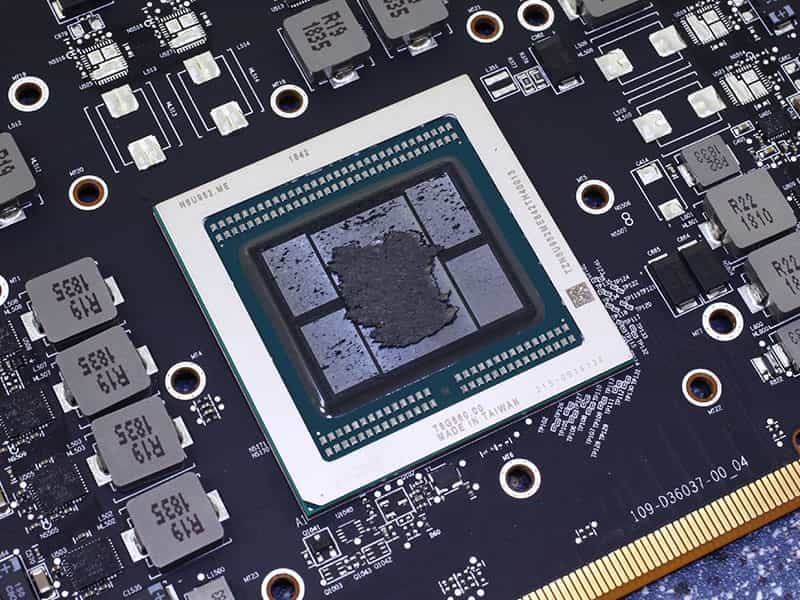

Tzv. unboxing publikoval například techPowerUp, ComputerBase nebo Tom's Hardware. Pokud preferujete video, má ho například HardOCP nebo také GamersNexus (na těchto videích je i rozebírání, o tom za chvíli). Karta, kterou můžete na fotkách/záznamech vidět, by měla odpovídat standardní prodejní verzi, ovšem jde o recenzentské sady. V jejich balení se nachází i akrylátový podstavec s osvícením, které mění barvy (pohání ho dvě tužkové baterky), a jeden reálný čip Vega 20 na ozdobu, patrně vadný. Tyto suvenýry v normálně prodávaném balení nečekejteChladič s vapor chamber a heatpipe

Fotky asi netřeba moc komentovat co do vzhledu. Kromě těch přímo zde v článku si můžete další vybrané obrázky poprohlížet v rozšířené galerii, odkazovaná na začátku a konci tohoto článku. Karta má pouzdro chladiče z hliníku, z kterého je i backplate, takže pokud tento materiál preferujete, budete spokojení. Povrch je hladký bez ozdob až po perforaci v backplate a přirozeně ventilátory. Výjimkou z tohoto je červený nápis Radeon na hřbetu karty a malá červená krychlička s písmenem R na jejím rohu u prostoru pro napájecí konektory. Po osazení a zapnutí tato místa červeně svítí.

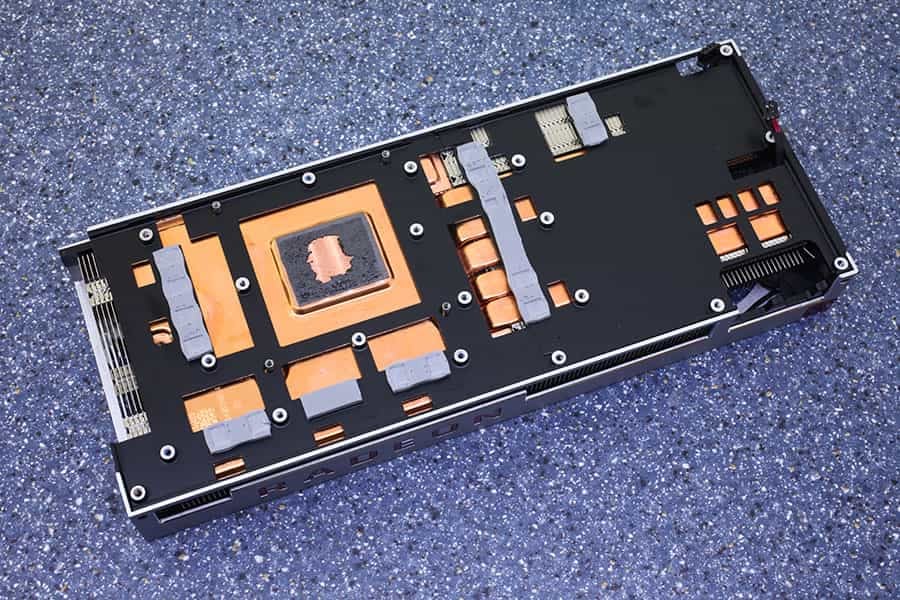

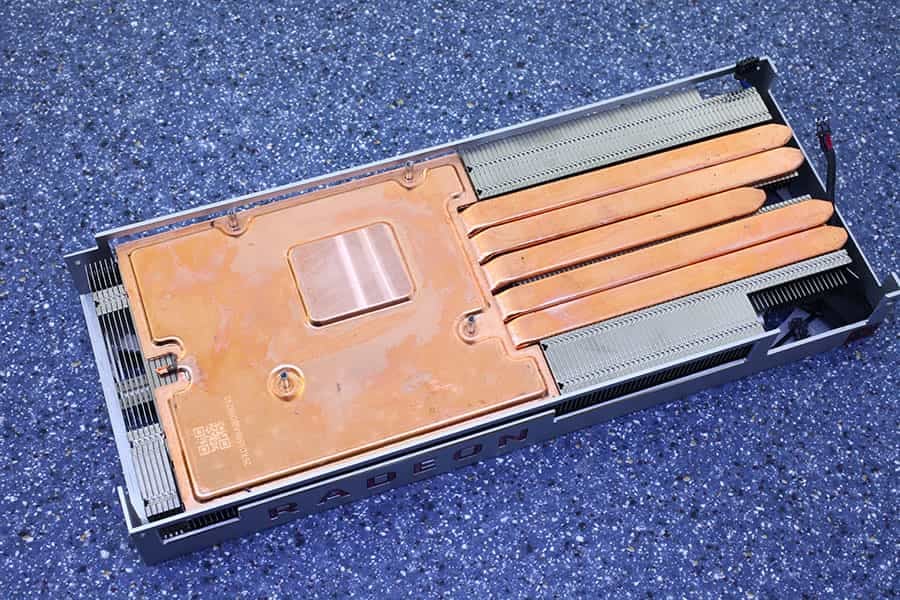

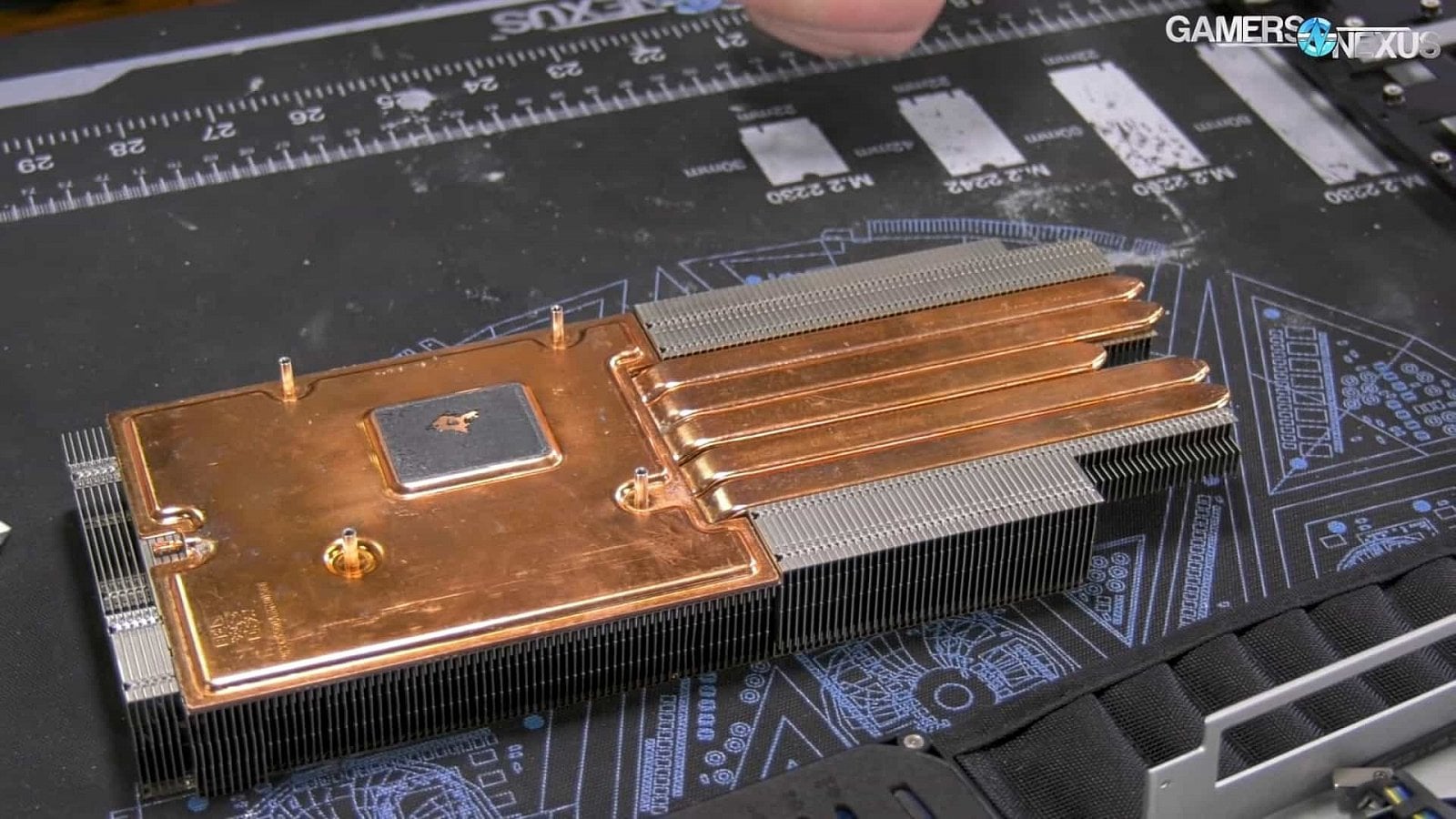

Chladič s třemi axiálními ventilátory některé weby sejmuly a rozebraly. Potřebujete k tomu kromě křížového také šroubovák typu Torx (T8 a T5), ale konstrukce a upevnění údajně nejsou tak komplikované, jako Founders Edition chladiče Turingů, není použito lepidlo. Díky rozborce víme, že základna chladiče je měděná a kombinuje vapor chamber a heatpipe. Vapor chamber v levé části chladiče je poměrně velká a tvoří hlavní základnu dotýkající se GPU. Pravá část pasivu je na ní napojená pěticí 10mm zploštěných měděných heatpipe, které jdou (kromě jedné kratší) po celé zbývající délce chladiče.

Mezi základnou chladiče a PCB je ještě ocelový baseplate, který ochlazuje VRM a je pro změnu ochlazován dotekem se spodkem pasivu. Když se podíváte zespodu na žebra, můžete vidět, že jejich sklady jsou po celé spodní ploše. To znamená, že vzduch neprochází chladičem kolmo až k baseplate, ale je vyfukován jen po stranách pasivu, kde je kryt otevřen. Polovina ho jde ven z karty, druhá polovina je vyfouknuta směrem k PCB základní desky. Jako u všech karet s axiálními otevřenými chladiči tohoto typu je tedy třeba mít dobře odvětrávanou skříň.

Speciální grafitová vložka místo pasty

Co je zajímavé, je přenos tepla. Mezi GPU základnou chladiče není teplovodivá pasta. Místo toho je použitá teplovodivá vložka, ovšem ne obyčejná. Má zřejmě jít o něco na bázi grafitových vláken, údajně o vložku Hitachi TC-HM03. Ta má mít efektivní tepelnou vodivost 25–45 W/mK (teoreticky až 90 v kolmém směru skrz plochu). To by bylo o dost víc než u běžných past, pokud by reálné chování odpovídalo. Důvod použití této vložky není znám, mohlo by jít buď o snazší montáž, nebo o to, že podložka snadněji vyrovná případné výchylky ve výšce pasivu nad GPU při ruční montáži karet.

Tato vložka se ale zdá se nedá s chladičem nedestruktivně sejmout – pokud byste ho demontovali, musíte být připraveni plochy očistit a aplikovat místo vložky nějakou kvalitní pastu. Otázka je, zda pak nebude chybět tloušťka, protože originální vložka není úplně nejtenčí. Zdá se tedy, že není dobrý nápad pasiv snímat, pokud k tomu nemáte důvod.

Hlučnost?

Mimochode, preview webu Tom's Hardware se zmiňuje, že Radeon VII je „hlasitý“. Pokud nejde o nějakou metaforu, patrně i přes axiální koncepci nemusí vůbec být tichý, i když mimo zátěž zdá se výjimečně hlasitý není (HardOCP ho má natočen po spuštění). To by se však mělo ve čtvrtek vyjasnit. Je celkem možné, že chladič není příliš optimalizován a vyladěn jako chladiče na nereferenčních kartách, protože byl vyroben speciálně pro tento model (u kterého se možná nečekají moc velké prodeje).

Co dalšího se ještě ve „vypixlováváních“ objevilo za informace? Radeon VII v tomto referenčním provedení váží 1,285 kg. Ventilátory označené FD8015H12S vyrábí firma FirstD a mají maximální proudový odběr 0,32 A (takže při plném tahu by chlazení teoreticky bralo až 12 W). Přimontované jsou přes malé plastové výběžky přímo k hliníkovému plechu krytu. Zajímavé je, že žebrování obklopuje na krajích ventilátory i z boku, což obvykle nebývá, pasiv je obvykle jen pod ventilátory. MOSFETy jsou na kartě použité International Rectifier/Infineon IR35401 (kontrolér je IR35207), takže napájení by mělo být opět docela kvalitní.