Včera jsme tu psali o výpočetním GPU (nebo možné „neGPU“) akcelerátoru AMD Instinct MI100 s čipem Arcturus. S tím firma možná i trošku překvapila, například zavedením akcelerátorů Matrix Core pro umělou inteligenci a také poměrně vysokým výkonem ve vědeckých výpočtech FP64, v kterých AMD tento akcelerátor vyhlásilo za nejvýkonnější na trhu.

Nvidia možná jeho uvedení čekala a vzápětí odhalila svou vlastní novinku. Firma vydala vylepšenou verzi svého akcelerátoru Nvidia A100 založeného na 7nm GPU GA100 generace Ampere a výrazně v něm posílila paměťovou propustnost. Tento akcelerátor je teď pro změnu novým rekordmanem v kapacitě pamětí a paměťové propustnosti, kde bylo poprvé dosaženo 2 TB/s. A také teď bude novým nejvýkonnějším GPU pro potřeby výpočtů umělé inteligence.

Nvidia A100 teď s 80GB pamětí

Stejně jako Arcturus byla tato novinka načasována veletrh SC20 zaměřený na superpočítače a HPC sektor. Jde i nejde o nové GPU. Základem je zdá se stejný 7nm křemík GA100, jaký Nvidia vydala na jaře – má aktivních 6912 shaderů s boostovým taktem 1,41 GHz, což dává teoretický výkon až 19,5 TFLOPS v přesnosti FP32 a 9,7 TFLOPS v dvojité přesnosti FP64.

Hrubý výkon výpočetních jednotek je podle specifikací stejný, a to i v tensor jádrech (až 312 TFLOPS pro FP16 operace, 624 TFLOPS pro INT8). O architektuře se dozvíte více v tomto článku:

Tip: Nvidia Ampere je tu: obří výpočetní GA100, 8192 shaderů. Architektura jde i do GeForce

Galerie: Nvidia Ampere je tu: obří výpočetní GA100, 8192 shaderů (Fotogalerie)

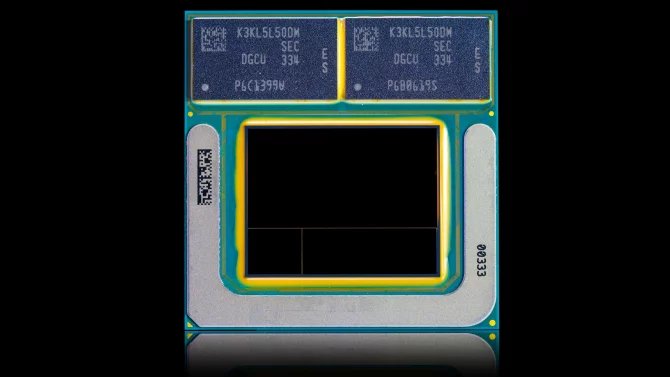

Zatímco křemík samotného GPU se nezměnil, Nvidia změnila osazení pamětí, které jsou integrované v jeho pouzdru na interposeru, takže pokud chápeme GPU jako celek, jde o novinku. Původní GA100 má fyzicky 6144bitovou paměťovou sběrnici s pamětí HBM2 na frekvenci 2,4 GHz efektivně. Ovšem patrně kvůli výtěžnosti je vždy jedno pouzdro neaktivní, takže reálně má GPU jen 5120bitovou sběrnici a pět aktivních pouzder s HBM2 po 8 GB – celkem je tedy kapacita 40 GB.

Poprvé HBM2e

Nová verze zachovává 5120bitovou sběrnici, a pořád tedy nepoužívá plnou šířku. Ale Nvidia osadila čipy s dvojnásobnou kapacitou 16 GB na jedno pouzdro, takže kapacita paměti u této verze A100 je 80 GB. Jde myslím o nejvyšší kapacitu, jakou kdy nějaké GPU mělo.

A navíc je místo paměti HBM2 použitá novější technologie HBM2e. Tyto paměti už běží na taktu 3,2 GHz efektivně. To při 5120bitové sběrnici dodává propustnost přesně 2,0 TB/s, opět absolutní a zatím zdaleka nevídaný rekord u čipů GPU. Pokud by Nvidia někdy vydala plně aktivovanou verzi těchto GPU s 6144bitovou sběrnicí, mělo by GPU 96 GB paměti a propustnost dokonce 2,4 TB/s.

Díky vyšší propustnosti by reálně tato verze měla mít lepší výkon než původní 40GB model, ač jsou počet jednotek a jejich takt stejné. Minimálně v oblasti umělé inteligence teď tedy půjde o nejvýkonnější GPU. Také kapacita může hrát významnou roli, protože do 80GB paměti se teď vejdou mnohem větší pracovní data. Takže tento počin může o dost posunou hranice toho, jaké výpočty jsou na GPU proveditelné.

GPU má nezměněné TDP o hodnotě 400 W. Provedení je mezaninové (tzv. SXM4), tedy na ploché desce osazované na speciální pozice v základní desce, což umožňuje použití konektivity NVLink a vyšší spotřebu než u karet PCI Express. Zda vydá Nvidia 80GB A100 s HBMe také v pomalejší verzi s nižší spotřebou ve formě karet PCI Express, netušíme.

Nvidia A100 s 80GB pamětí se bude prodávat současně se starším modelem s kapacitou 40 GB, novinka bude logicky asi výrazně dražší, kdežto 40GB verze k ní bude dále k dispozici jako ekonomická alternativa. Dostupnost má začít od ledna s většími dodávkami v únoru 2021. Už teď ale předběžně dostávají exempláře 80GB A100 někteří vybraní provozovatelé superpočítačů, takže někde jsou již nové A100ky nyní v provozu.

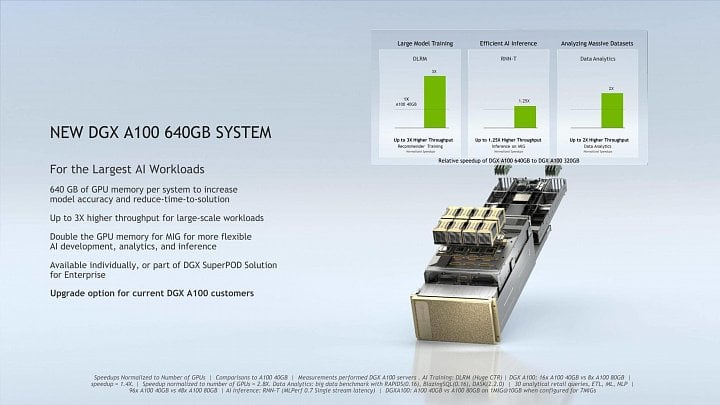

Server se 640 GB grafické paměti (dost pro každého?)

Firma také oznámila nový vlastní výpočetní server DGX A100 640GB, který má tato 80GB GPU osazená v počtu osmi kusů, a také nový stroj s formátem pracovní stanice typu Tower – DGX Station.

Tato pracovní stanice obsahuje čtyřikrát akcelerátor A100 80GB pořád v provedení SXM4 modulu, ovšem ne s vodním či vzduchovým chlazením, ale s nějakým subambinentním, používajícím podchlazení chladícího média (údajně je to ale bezúdržbový systém).